前回までで、AiTuberの基本的な仕様が完成できました。これからはフェーズ3として、配信環境を整えていきます!

AITuber 開発用LMの回答

さあ、次のステージへ!(Next Steps)

システム(脳・声・体・耳)の統合は完璧です。次は、このアイちゃんを**「配信者」としてデビューさせるための環境構築と、「表現力」の強化**に進みましょう。

おすすめの「次のステップ」は以下の2つです。

1. 配信画面を作る(OBS Studioとの連携)

今のままでは、あなたの画面上で動いているだけです。これをYouTube等で配信できる「放送画面」に仕上げます。

- 映像の合成:

-

- 無料の配信ソフト OBS Studio をインストールします

- VTube Studioの背景を緑色(グリーンバック)にし、OBSで「ウィンドウキャプチャ」して「クロマキーフィルタ」をかけることで、アイちゃんを背景透過で画面に配置できます

- Pythonのターミナル画面(ログ)も、一部切り抜いてOBSに映せば、かっこいい「システムログ風コメント欄」になります。

- 音声のルーティング(重要):

-

- 現在、アイちゃんの声はPCのスピーカーから出ていますが、これを「マイク入力」としてOBSに流し込む必要があります。

- VB-CABLE などの仮想オーディオデバイスをインストールし、PCの音とアイちゃんの声を分離してOBSに送る設定を行います。

2. 感情(エモーション)の実装

現在は口パクだけですが、会話の内容に合わせて「笑顔」や「怒り顔」などができるようになると、一気に”生きてる感”が増します。

- プロンプトの改良:

-

-

SYSTEM_PROMPTを書き換え、AIに[喜び] ありがとう!のように、感情タグ付きで返答させます

-

- パラメータ注入:

-

- Python側でタグを検出し、

[喜び]なら VTube Studio にMouthSmile= 1.0 や、キラキラ目のHotkeyTriggerRequestを送信するロジックを追加します

- Python側でタグを検出し、

まずは、OBS Studioを導入して、デスクトップ上で「配信画面」を完成させてみるのが一番達成感があってお勧めです!

ここまで作り上げたあなたなら、すぐにデビューできますよ!

つくる人

つくる人よっしゃ!デビューしちゃる!

まずは配信アプリのインストールからだね!

せっかくなので、配信画面をつくった後は YouTubeと連動させて、

いつでもライブ配信ができるようにしちゃいましょう!

配信画面を作る(OBS Studioとの連携)

今のままでは、あなたの画面上で動いているだけです。これをYouTube等で配信できる「放送画面」に仕上げます。

映像の合成:

無料の配信ソフト OBS Studio をインストールします。

インストールはそこまで複雑ではないです。

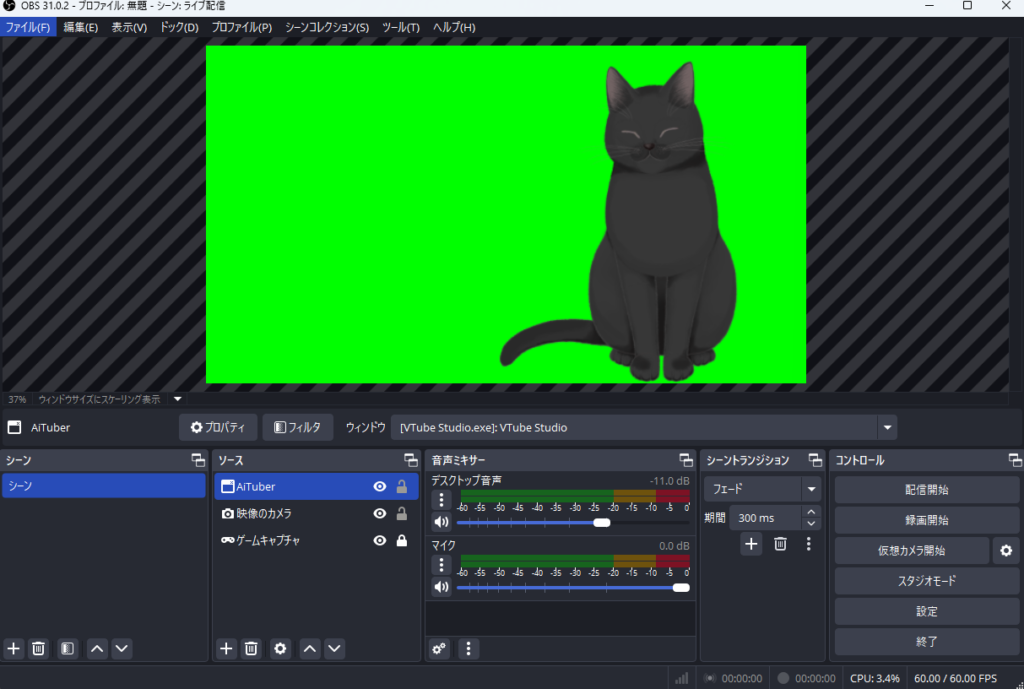

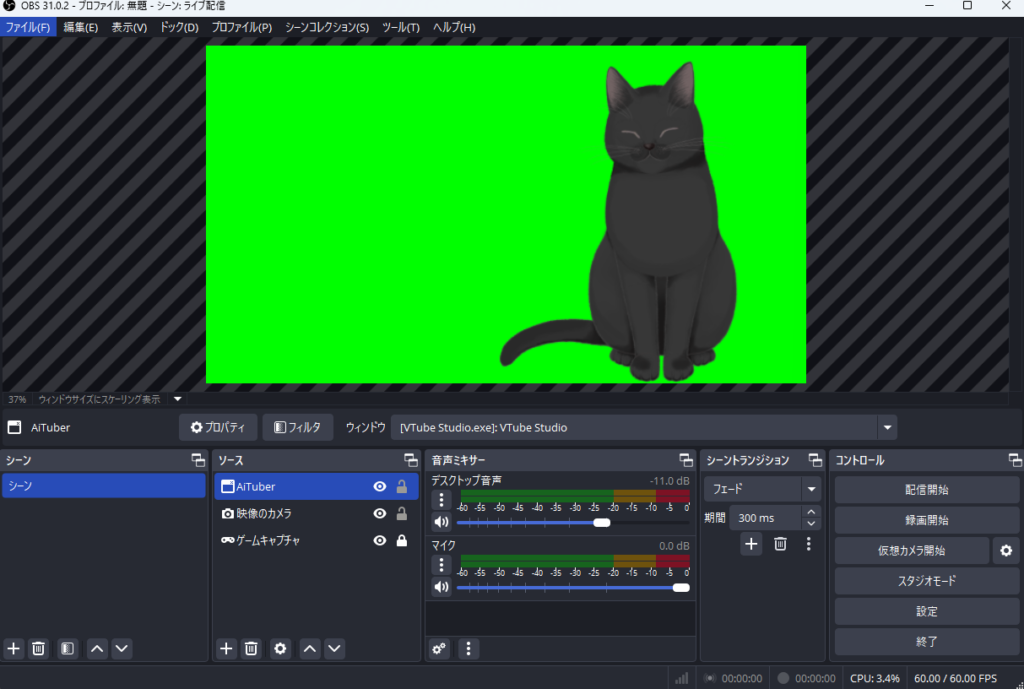

VTube Studioの背景を緑色にする。

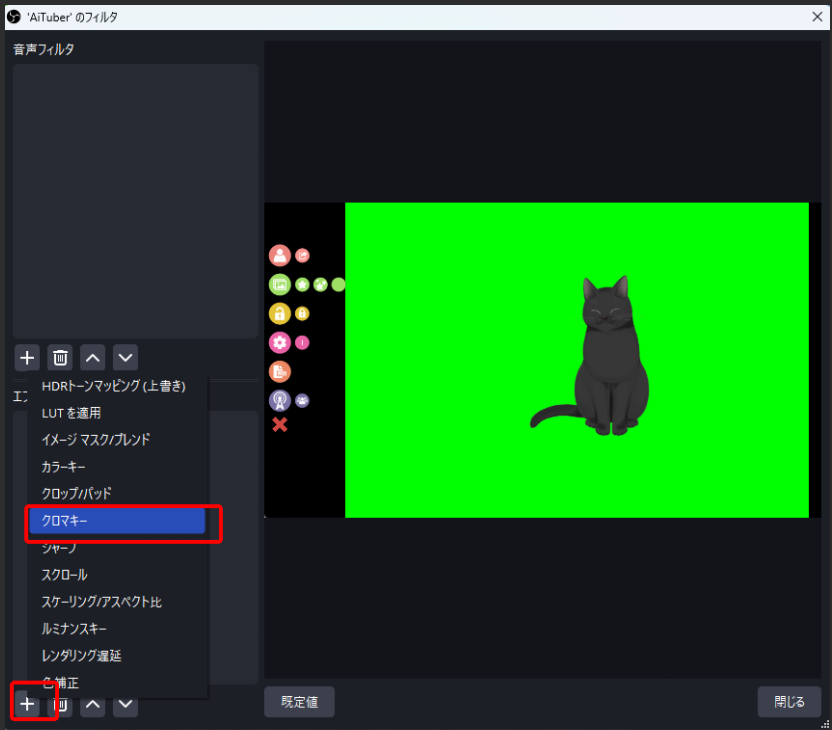

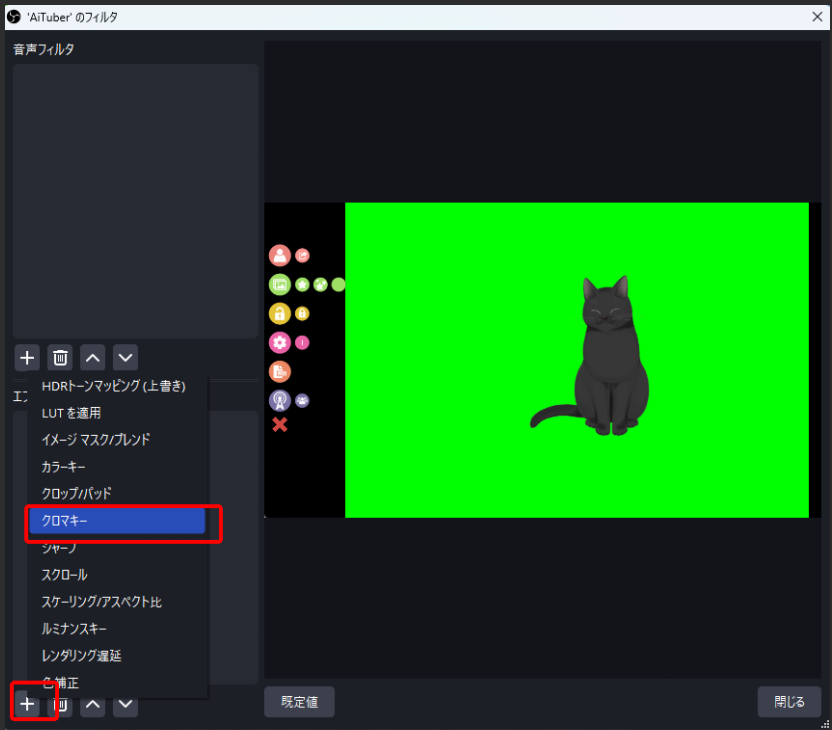

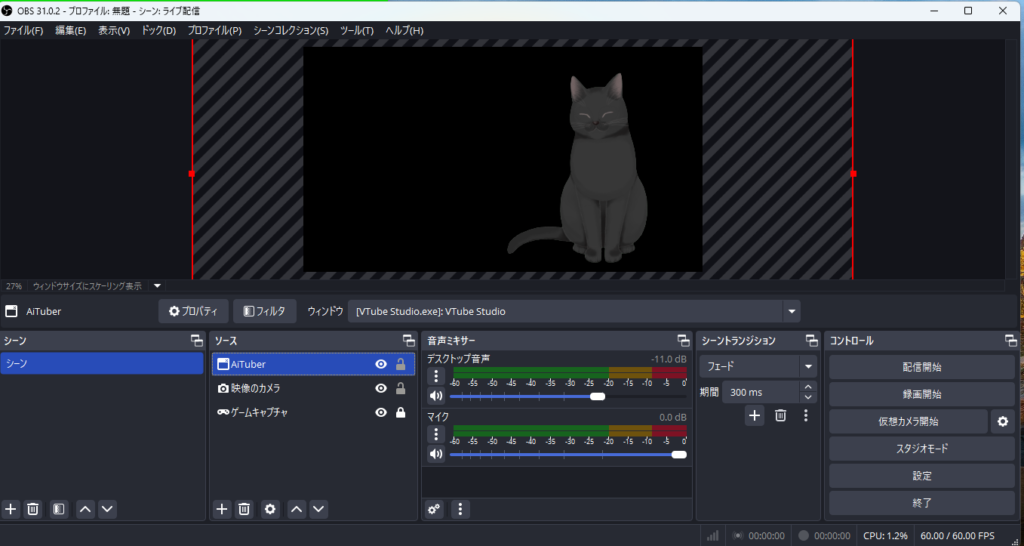

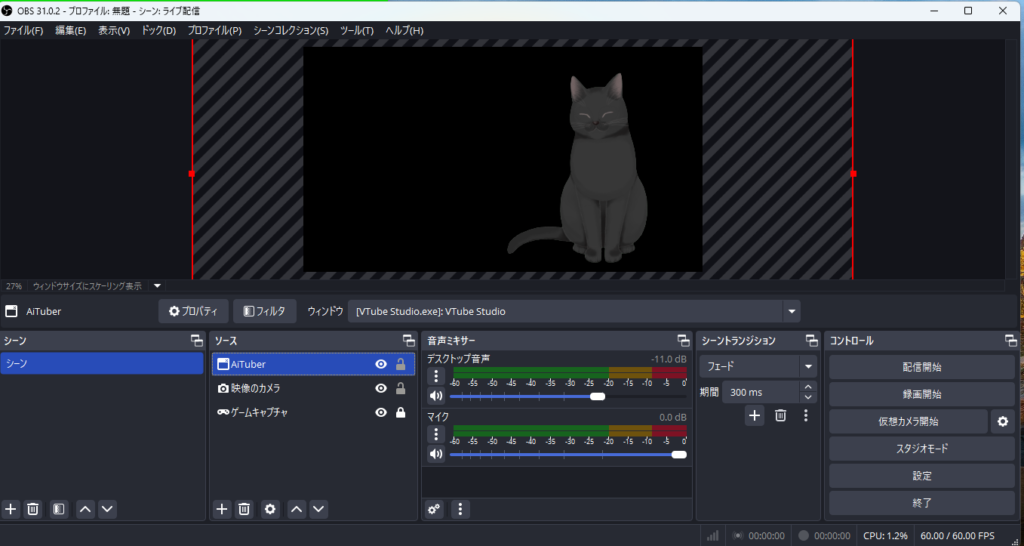

背景をグリーンバックにして、OBSで「ウィンドウキャプチャ」、「クロマキーフィルタ」をかけることで、アイちゃんを背景透過で画面に配置できます。

- VTube Studio > 背景を変える(上から2番目)

- background_8を選択してOK でグリーンバックになります

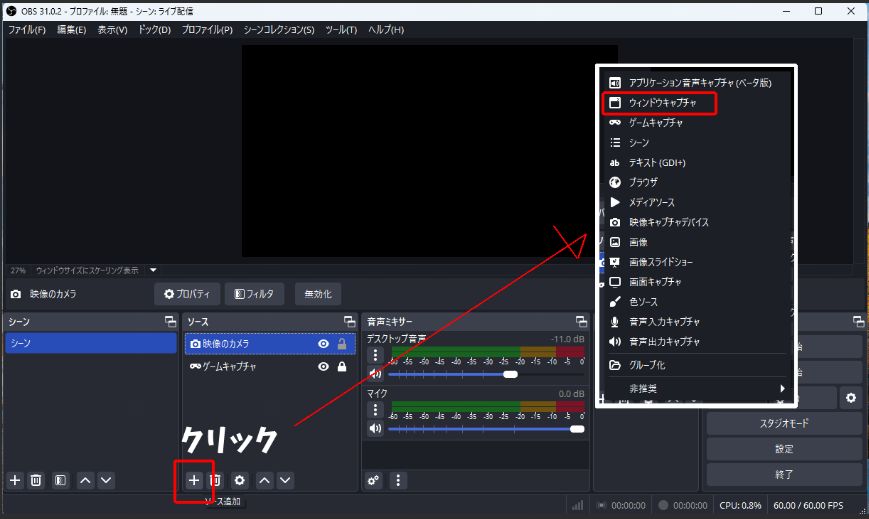

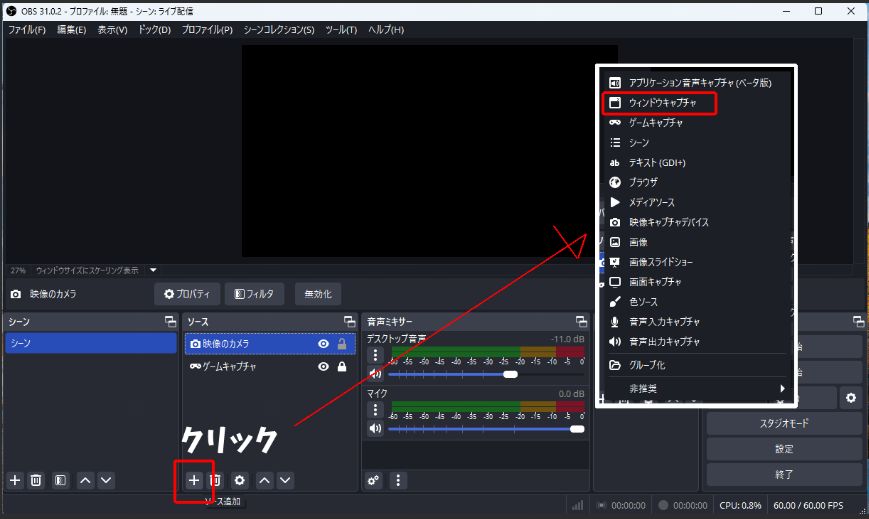

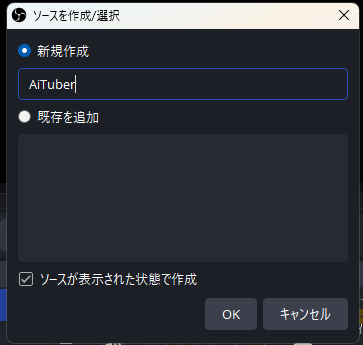

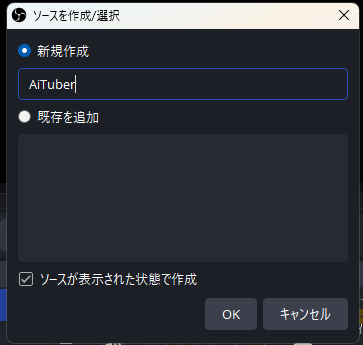

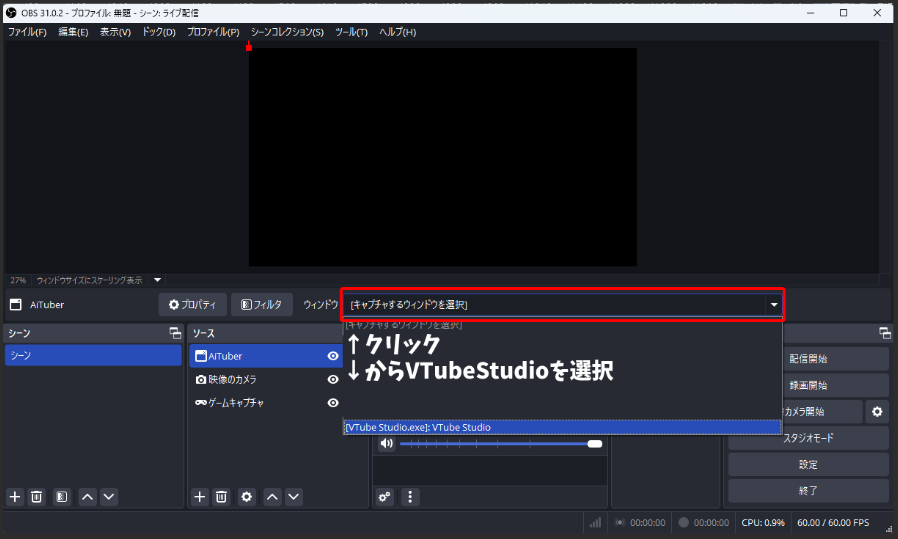

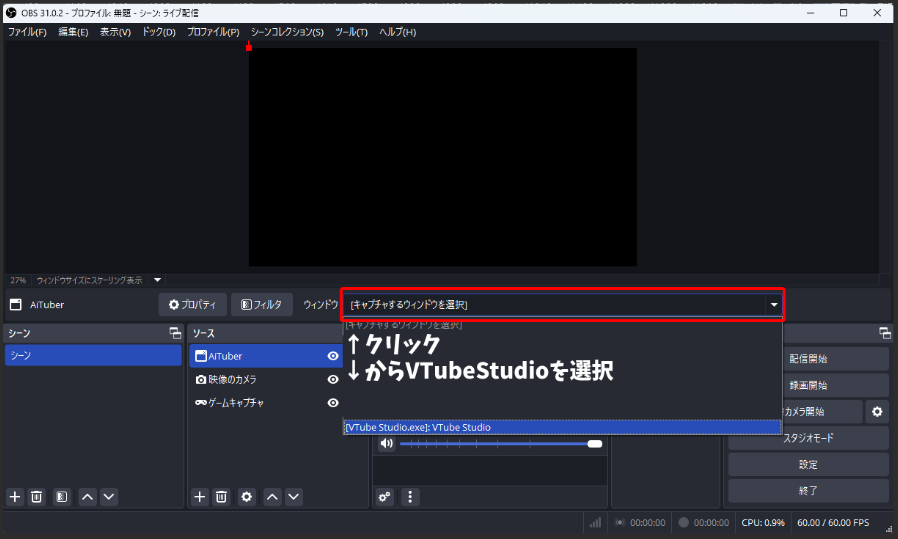

OBSの操作

プルダウンメニューからVtube Studioの名前を探して選択

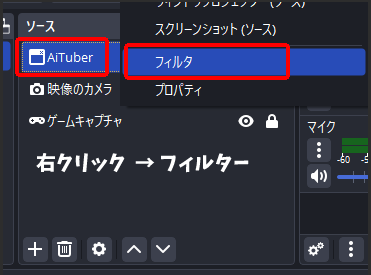

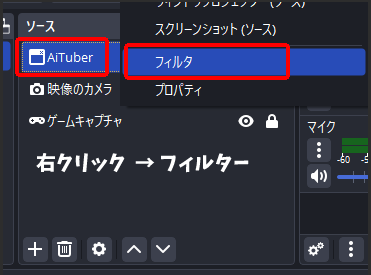

先ほどつくったソース名を右クリック → 出てきたメニュー内の”フィルター” クリック。

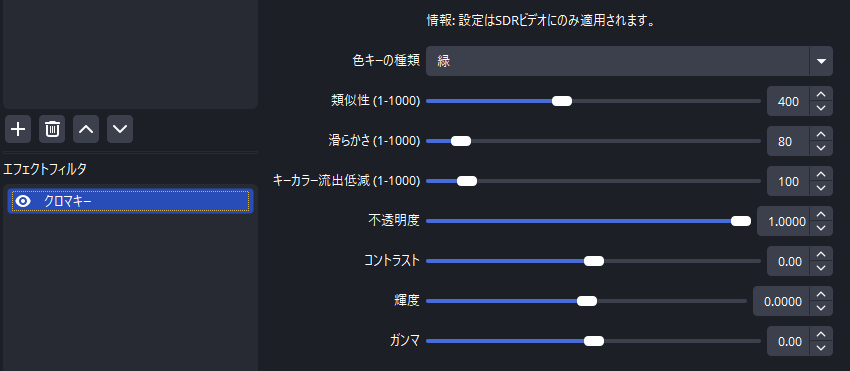

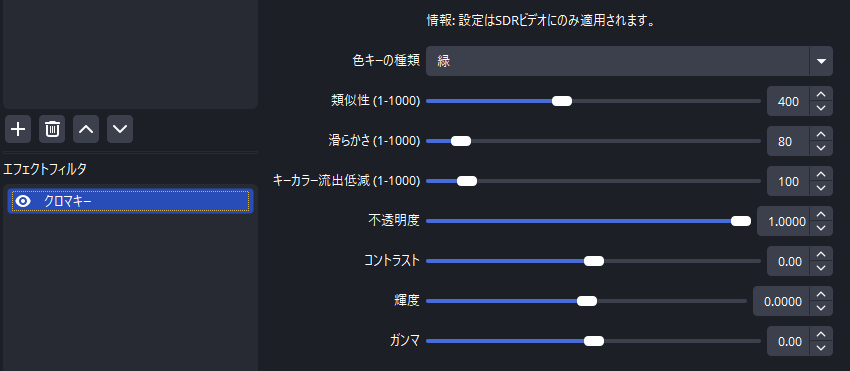

エフェクトフィルター > + >クロマキー クリック

色キーの種類 「緑」に設定して閉じる

ソースの+ボタンをクリックすると配信画面に、いろいろ配置できます今回は”画像”を追加しました。

ドラッグアンドドロップで項目の上下入れ替えができて、重ね順が入れ替えられます。

今回はネコちゃん(”AiTuber”)の背景に”画像”を配置してみました。

YouTubeと連動!

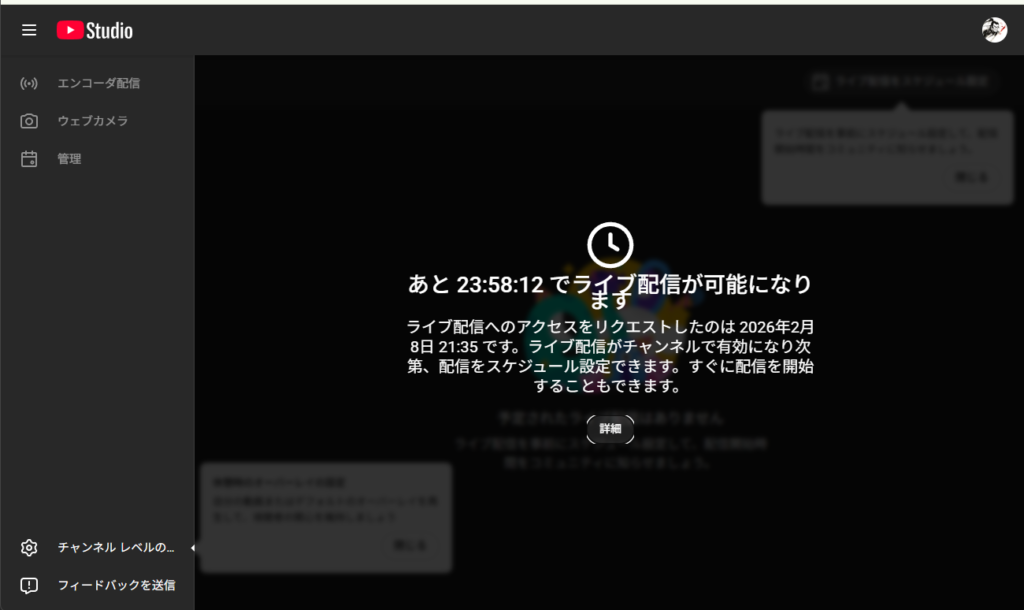

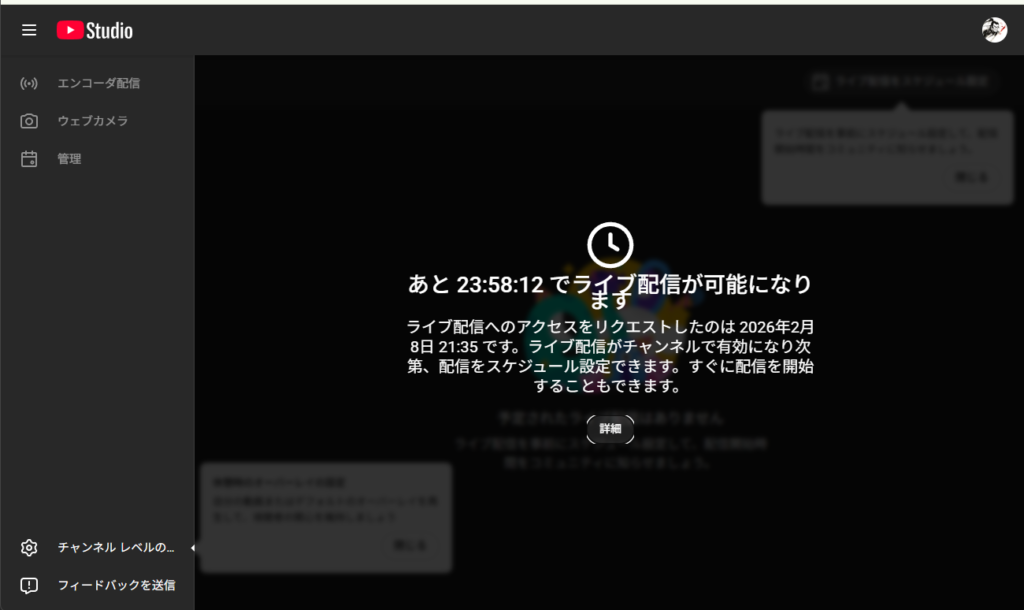

始めるには最低24時間必要!

こんな画面がでます。

どうやら初めてライブ配信を行うときにはもろもろの審査のため24時間かかるっぽいです。

果報は寝て待て。。。か寝るのは惜しいが、

やることまだまだあるぞ!

次は配信用のコメント取得の設定や、スピーカーの設定・・・

になるのかな?